Programmatic SEO en 2026 : quand ça marche encore, quand Google pénalise, et comment faire la différence

Le programmatic SEO n'est pas mort. Il n'est juste plus facile. Voici le cadre que nous utilisons en 2026 pour décider si un projet de programmatic SEO va capitaliser du trafic ou se faire détruire par le Helpful Content system dans six mois.

16 min de lecture

Le programmatic SEO a vécu un 2024 brutal et un 2025 compliqué. Site après site a publié des dizaines de milliers de pages templatisées, s'est bien classé pendant six mois, puis s'est fait détruire par une mise à jour Helpful Content ou les spam policies de mars 2024. La réaction a été un balancement de pendule à l'échelle de l'industrie : "le programmatic SEO est mort", "Google l'a tué", "faites du vrai contenu à la place".

Cette prise de position est fausse. Les chiffres sont plus intéressants.

Le programmatic SEO fonctionne encore en 2026. Il n'est juste plus facile. Les pages qui survivent aux updates Google et qui se font citer par les agents IA partagent un petit ensemble de propriétés structurelles, et les pages qui se font détruire partagent un ensemble tout aussi identifiable. La différence n'est pas le nombre de pages que vous publiez. C'est ce qu'il y a comme données sous les pages.

Ce post est le cadre que nous utilisons quand un client demande "devrions-nous lancer un projet de programmatic SEO ?". Certains de ces projets, nous les prenons. La plupart, nous recommandons de ne pas les faire. La décision est rarement une question d'ambition ou de budget. C'est de savoir si les données sous-jacentes justifient les pages ou non.

Ce qu'est vraiment le programmatic SEO

Le terme est utilisé de façon floue. Resserrons-le.

Le programmatic SEO est la pratique consistant à générer beaucoup de pages depuis un jeu de données structuré et un template, où chaque page cible une requête longue traîne qui correspond à une ligne ou une combinaison de lignes dans ce jeu de données. Les formes classiques sont [produit] à [ville], [outil] vs [outil], [intitulé de poste] salaire à [pays], meilleur [chose] pour [cas d'usage], et comment [tâche] dans [logiciel].

La raison pour laquelle cela fonctionne est que les requêtes longue traîne représentent collectivement la majorité du volume de recherche mais chaque requête individuelle a trop peu de volume pour qu'un article écrit à la main soit rentable. Si vous pouvez servir 50 000 requêtes longue traîne avec un template et un dataset, vous avez construit un actif de contenu qu'aucune équipe contenu manuelle ne peut concurrencer sur le coût.

La raison pour laquelle cela échoue est que la même propriété (beaucoup de pages depuis un template) est identique à du spam à grande échelle, sauf si les pages sont différenciées par des données réellement utiles, spécifiques à la requête. Les spam policies de Google en 2024 et 2025 ont explicitement nommé le "scaled content abuse" comme catégorie, et le Helpful Content system a été ré-entraîné pour identifier les pages qui existent principalement pour les moteurs de recherche plutôt que pour les humains. Le programmatic SEO sans valeur sous-jacente est exactement ce pattern.

Les six tests qui déterminent si votre projet survit

Faites passer un projet de programmatic SEO par ces six tests avant d'écrire une seule ligne de code. Nous avons audité assez de post-mortems pour savoir que les projets qui passent les six survivent aux updates Google et au filtrage des agents IA. Les projets qui échouent à deux ou plus sont éliminés dans les douze mois.

Test 1 : chaque page contient-elle des données qu'un utilisateur ne pourrait pas obtenir ailleurs en une seule requête ?

C'est le test le plus important. Si votre page [restaurant] à [quartier] est une liste de noms de restaurants avec les horaires pompés depuis Google Maps, l'utilisateur aurait pu rester sur Google Maps. La page n'a aucune raison d'exister.

Si votre page inclut le prix moyen par couvert par quartier, la distribution des cuisines, le pourcentage de restaurants ouverts après 23h, et des liens pour réserver, l'utilisateur a obtenu quelque chose qu'il n'aurait pas pu assembler en une requête. C'est la différence entre du scaled content et un annuaire utile.

Resserrez le test : imaginez l'utilisateur avec une barre Google ouverte. S'il peut répondre à sa question en une recherche qui ne mène pas à votre page, votre page fournit zéro valeur marginale. L'algorithme Google fait le même jugement.

Test 2 : les données sont-elles fraîches, ou figées dans le temps ?

Les pages dont les données ont été scrapées une fois en 2022 et jamais mises à jour sont faciles à identifier. Les prix produits sont faux, l'entreprise est maintenant sous un autre nom, la loi référencée a changé, le chiffre de population vient du dernier recensement il y a deux cycles. Les agents IA attrapent cela plus vite que Google parce qu'ils recoupent contre plusieurs sources.

Un projet de programmatic SEO qui n'a pas de pipeline de refresh dans son architecture n'est pas un projet. C'est de la dette de contenu. La cadence de refresh dépend de ce qui change : hebdomadaire pour les pages prix, mensuel pour les comparatifs produits, trimestriel pour les stats sectorielles, annuel pour les pages d'attributs evergreen.

Test 3 : assez de pages ont-elles du contenu spécifique et utile au-delà du template ?

Le template fournit la structure cohérente. Les données fournissent la différenciation. Mais le template plus les données seuls suffisent rarement. Les pages qui se classent en 2026 ont typiquement aussi :

- Un résumé ou une analyse spécifique à la page (qui peut être généré, mais doit être spécifique aux données de cette page, pas du boilerplate)

- Des exemples ou scénarios spécifiques à la combinaison de variables de la page

- Une manière pour les utilisateurs de faire une action significative depuis la page

La barre est à peu près que 30% à 50% des mots de chaque page soient spécifiques à cette page plutôt que partagés avec toutes les autres pages du set. Les templates avec 90% de contenu partagé sont filtrés.

Test 4 : la structure d'URL est-elle propre et stable ?

Les projets programmatic commencent souvent avec des URLs sales. Paramètres, IDs dynamiques, casse bizarre. À long terme c'est toxique. La structure d'URL doit être :

- En minuscules, avec des tirets, sans paramètres

- Hiérarchique quand il y a une vraie hiérarchie (

/jobs/developpeur/paris) - Plate quand il n'y en a pas (

/saas-tools/email-marketing-vs-marketing-automation) - Stable. Les pages qui changent d'URL à chaque régénération perdent toute leur autorité de liens.

La décision de rendre les URLs hiérarchiques ou plates n'est pas esthétique. Elle dépend de si les utilisateurs naviguent par la hiérarchie. Si les utilisateurs vont de /jobs à /jobs/developpeur à /jobs/developpeur/paris, la hiérarchie est réelle. S'ils n'atterrissent que sur la page feuille, la hiérarchie est du théâtre.

Test 5 : les pages se lient-elles entre elles dans un graph utile, pas un graph de spam ?

Le maillage interne sur les sites de programmatic SEO est le signal le plus facile à lire d'une intention de basse qualité. Une page sur "Restaurants italiens dans le 11e arrondissement" devrait lier vers "Restaurants italiens dans les arrondissements voisins" et "Restaurants italiens dans la même gamme de prix dans le 11e", pas vers 47 pages sans rapport dans un footer.

La règle que nous utilisons : les liens depuis une page doivent être les liens qu'un utilisateur sur cette page voudrait réellement suivre. Si la cible du lien n'est pas quelque chose qu'un utilisateur réel cliquerait, Google ne le comptera pas non plus comme une recommandation.

Test 6 : le business sous-jacent est-il viable sans ce trafic ?

C'est le test que la plupart des équipes sautent et celui qui compte le plus pour la gestion du risque. Le trafic programmatic SEO peut capitaliser pendant des années puis disparaître en une seule update. Si votre modèle s'effondre sans lui, vous construisez sur du sable.

Le pattern sain est : les pages programmatic font venir les utilisateurs, le produit les convertit, le produit crée de la valeur qui ne dépend pas de la visibilité search continue. Le succès client, la rétention, l'expansion, le bouche-à-oreille : tous doivent fonctionner indépendamment. Le programmatic SEO est alors un canal d'acquisition client, pas le business.

Nous avons vu le pattern d'échec assez de fois pour le nommer : une startup construit 50 000 pages programmatic, se classe pour 200 000 requêtes longue traîne, convertit à 0,8%, construit un business sur le trafic, et une update Google au mois 18 essuie 70% du trafic. Ils ne récupèrent jamais parce que le canal d'acquisition était le business.

Les trois formes qui fonctionnent encore

Sur les projets que nous avons audités qui ont survécu à 2024 et 2025 et qui continuent à capitaliser en 2026, trois formes reviennent. Si votre projet ne rentre pas dans une de ces trois, la barre est beaucoup plus haute et le taux d'échec est beaucoup plus haut.

Forme A : annuaire autoritaire adossé à des données propriétaires

Un annuaire qui liste des entités (restaurants, avocats, logiciels, formations, biens immobiliers) où les données sont curées, vérifiées, maintenues fraîches et incluent des attributs qui ne sont pas trivialement disponibles ailleurs. Exemples qui ont survécu : annuaires juridiques avec admissions au barreau vérifiées, annuaires de logiciels avec prix normalisés et données d'intégration, plateformes immobilières avec données multi-courtiers consolidées.

La défensabilité vient des données, pas du SEO. Le SEO capitalise parce que les données sont réellement utiles.

Forme B : pages de comparaison et d'aide à la décision avec un vrai raisonnement

Les pages [Outil A] vs [Outil B] fonctionnent quand elles comparent vraiment. La page a besoin de critères (spécifiques à la catégorie), d'évaluations contre chaque critère (spécifiques à chaque outil) et d'un verdict (spécifique aux cas d'usage). Le template fournit la structure. Le contenu par cellule est curé à la main ou, de plus en plus, généré depuis une base de données structurée avec relecture humaine.

Le mode d'échec est les pages [Outil A] vs [Outil B] où la comparaison est vide : chaque cellule dit "supporte l'email", "a des intégrations", "facile à utiliser". Les pages comme cela échouent à chaque test ci-dessus et sont filtrées.

Forme C : pages locales adossées à un vrai service local

Les pages [Service] à [ville] fonctionnent quand le service est réellement délivré dans la ville. Une entreprise de plomberie avec des techniciens dans 40 villes françaises peut faire tourner crédiblement 40 pages locales. Un SaaS qui livre depuis un seul bureau à Paris ne peut pas faire tourner crédiblement 200 pages de localisation, et Google a été efficace à distinguer les deux depuis 2024.

Le test est de savoir si quelqu'un dans la ville listée, en appelant le numéro de téléphone sur la page, serait servi. Si oui, la page a une raison d'exister. Si non, vous faites semblant et l'algorithme finira par rattraper.

Ce qui a changé en 2024-2025 (et ce qui est différent en 2026)

Pour le contexte sur pourquoi tant de projets programmatic sont morts, voici la version courte.

L'update core de Google de mars 2024 a ciblé explicitement le scaled content abuse. La mise à jour de policy a rendu possible pour Google d'agir contre les sites qui "produisent du contenu à l'échelle principalement pour les classements moteur de recherche, peu importe si de l'IA, de l'automatisation ou des humains sont impliqués". Beaucoup de sites de programmatic SEO qui se classaient depuis des années ont été déclassés en quelques semaines.

Le Helpful Content system, qui avait été un signal séparé, a été intégré dans l'algorithme de ranking core dans la même release. Cela a rendu impossible la récupération rapide : avant, un site pouvait perdre son scoring helpful content, corriger le problème et récupérer dans un refresh futur. Une fois devenu core, le chemin de récupération est devenu "reconstruire quoi que ce soit qui contrarie le signal plus large de Google", ce qui est plus flou.

À travers 2025, les surfaces de recherche IA (ChatGPT, Perplexity, Google AI Overviews, Microsoft Copilot) ont ajouté un deuxième filtre. Les agents IA citent leurs sources, et ils préfèrent les sources avec de la profondeur, de la spécificité et des affirmations vérifiables. Les pages programmatic minces sont filtrées des citations IA même quand elles se classent techniquement dans Google classique.

En 2026, la barre est plus haute que jamais. La bonne nouvelle est que la barre est cohérente. Les pages qui fournissent une vraie valeur à une requête sont visibles sur Google classique, Google AI Mode, ChatGPT et Copilot simultanément. Les pages qui ne le font pas sont filtrées par tous.

⚠

Un projet de programmatic SEO en 2026 doit être conçu simultanément pour les utilisateurs humains, le ranking Google classique et la citation par les agents IA. N'optimiser que pour un des trois est une recette soit pour un échec immédiat (les humains rebondissent, la conversion est nulle) soit pour un échec dans une update future (l'algorithme rattrape).

Le cadre de décision, dans l'ordre

Quand un client nous interroge sur un projet de programmatic SEO, nous déroulons cela dans cet ordre exact :

Étape 1 : qu'est-ce que l'utilisateur essaie réellement d'accomplir ? Écrivez la requête que l'utilisateur taperait. Écrivez la réponse dont il a besoin. Écrivez les alternatives qu'il a aujourd'hui. Si les alternatives sont suffisantes, ne construisez pas la page.

Étape 2 : quel est le dataset sous-jacent ? D'où vient-il, à quel point est-il frais, à quel point est-il propriétaire, à quel point est-il dur à maintenir ? Si la réponse est "nous allons scraper Google Maps une fois", le projet est mort avant de commencer.

Étape 3 : quelle est la différenciation par page ? Qu'est-ce qui change entre les pages ? Si la réponse est "le nom de la ville et le titre", le projet est du scaled content. Si la réponse est "tous les attributs structurés plus un résumé spécifique plus les entités locales pertinentes", le projet peut fonctionner.

Étape 4 : combien de pages, réalistiquement ? Les requêtes longue traîne avec un volume significatif sont plus rares qu'il n'y paraît. La plupart des catégories supportent 200 à 2 000 pages programmatic utiles, pas 50 000. Soyez sceptique des plans pour des dizaines de milliers de pages sur un sujet qui ne le justifie pas.

Étape 5 : quel est le plan de maintenance ? Qui rafraîchit les données, à quelle cadence, avec quel monitoring ? Un projet de programmatic SEO sans plan de maintenance est une publication one-shot qui se dégrade.

Étape 6 : quelle est la concentration du risque ? Si ce canal disparaît, qu'arrive-t-il au business ? Si la réponse est "nous mettons la clé sous la porte", le projet est trop risqué et la stratégie est incomplète.

Les projets qui passent les six valent le coup. Les projets qui échouent à un ou deux peuvent encore valoir le coup si les critères ratés peuvent être corrigés. Les projets qui échouent à trois ou plus devraient être abandonnés au profit d'autre chose.

Le pattern d'implémentation que nous utilisons

Pour les projets que nous construisons, le pattern technique est constant et pas particulièrement exotique.

La couche de données est une base de données (Postgres typiquement, parfois Airtable pour les plus petits projets) ou une source de données structurée comme une collection Shopify Metaobject ou un Google Sheet. Critique : les données sont possédées par le business, pas scrapées à la volée. Les données scrapées meurent ; les données possédées capitalisent.

La couche de rendu est un générateur de site statique (Next.js avec revalidation à la demande, Astro, Hugo pour les projets à très grand nombre de pages, ou Hydrogen s'il vit dans Shopify) qui tire de la couche de données au build et produit du HTML statique. Nous évitons les pages programmatic rendues côté client ; elles sont plus lentes, chères à crawler, et se classent moins bien.

Le maillage interne est généré algorithmiquement mais contraint à des pages réellement liées. Nous calculons des scores de similarité entre pages (par attributs partagés, proximité géographique, chevauchement de catégorie) et limitons les liens sortants de chaque page à ses 8 à 12 pages liées les mieux notées. Pas de blocs de liens en footer, pas de listes "voir aussi" exhaustives.

Le pipeline de refresh tourne sur un schedule approprié aux données. Les données prix se rafraîchissent quotidiennement. Les données géographiques se rafraîchissent mensuellement. Les statistiques au niveau catégorie se rafraîchissent trimestriellement. Nous monitorons les changements et reconstruisons les pages affectées, pas tout le site.

L'observabilité est non négociable. Nous trackons le trafic par page, la conversion, et l'inclusion dans les citations IA. Les pages qui sous-performent de façon constante sont revues, améliorées ou retirées. Les sites de programmatic SEO qui ne taillent jamais leurs propres sous-performances accumulent du poids mort qui finit par tirer le site entier vers le bas.

FAQ

Le programmatic SEO vaut-il le coup en 2026 ?

Pour les projets qui passent le cadre à six tests ci-dessus, oui. Pour les projets qui ne passent pas, non. Les réponses générales ("oui, ça marche encore" ou "non, Google l'a tué") sont toutes les deux fausses parce qu'elles ignorent la propriété sous-jacente : le programmatic SEO est un mécanisme de livraison. Que le mécanisme de livraison réussisse dépend entièrement de ce qui est livré.

Combien de pages devrais-je publier ?

Autant que les données le justifient. La plupart des catégories supportent quelques centaines à quelques milliers. Si vos données ne supportent que 500 pages utiles, en publier 50 000 est pire que d'en publier 500. Les pages vides tirent les bonnes vers le bas.

La recherche IA va-t-elle rendre le programmatic SEO obsolète ?

Elle change la barre mais n'élimine pas le canal. Les agents IA ont besoin de sources à citer. Les sources avec des données structurées et vérifiables sont exactement ce qu'ils préfèrent. Les pages qui survivent dans Google classique tendent aussi à être les pages citées par les agents IA. Les deux filtres pointent dans la même direction.

Puis-je générer le contenu spécifique aux pages avec de l'IA ?

Oui, avec une grosse réserve. Le texte généré par IA est OK quand il résume ou explique les données structurées sous-jacentes de la page. Il n'est pas OK quand il est le seul contenu de la page. La barre est de savoir si le contenu reflète quelque chose de spécifique et vrai sur cette page, pas si un humain ou une IA l'a écrit.

Combien de temps avant de voir des résultats ?

Le programmatic SEO prend typiquement 4 à 9 mois pour voir du trafic significatif, avec la courbe qui continue à capitaliser pendant 18 à 36 mois sur les projets qui réussissent. Quiconque promet des résultats plus rapides est soit chanceux, soit menteur, soit sur le point de se faire pénaliser.

Et le hreflang et le programmatic SEO international ?

Ajouter des variantes de langue et de pays multiplie le nombre de pages et la complexité. Nous avons couvert la configuration hreflang dans hreflang sur Shopify pour l'ecommerce, et les principes se transfèrent. La contrainte clé : les traductions doivent être de vraies traductions contre un dataset local vérifié. Les pages programmatic auto-traduites pour des marchés où les données ne sont pas validées sont exactement le pattern que Google a déclassé en 2024.

Où ce post se place dans notre stack plus large

Le programmatic SEO est un canal dans une stratégie technique SEO et contenu plus large. Il se marie bien avec le schema markup (qui donne à chaque page programmatic des données structurées pour les agents IA) et une architecture metaobject propre quand le dataset sous-jacent vit dans Shopify.

Si vous pesez si un projet de programmatic SEO a du sens pour votre business, contactez-nous. Nous commençons chaque engagement avec le cadre à six tests ci-dessus. Environ la moitié des conversations se terminent par "ce projet n'est pas adapté, voici quoi faire à la place". L'autre moitié, nous les construisons, et ils tendent à capitaliser pendant des années parce que nous filtrons les structurellement bancals au départ.

Articles connexes

Tous les articles

Technical SEOApr 14, 2026

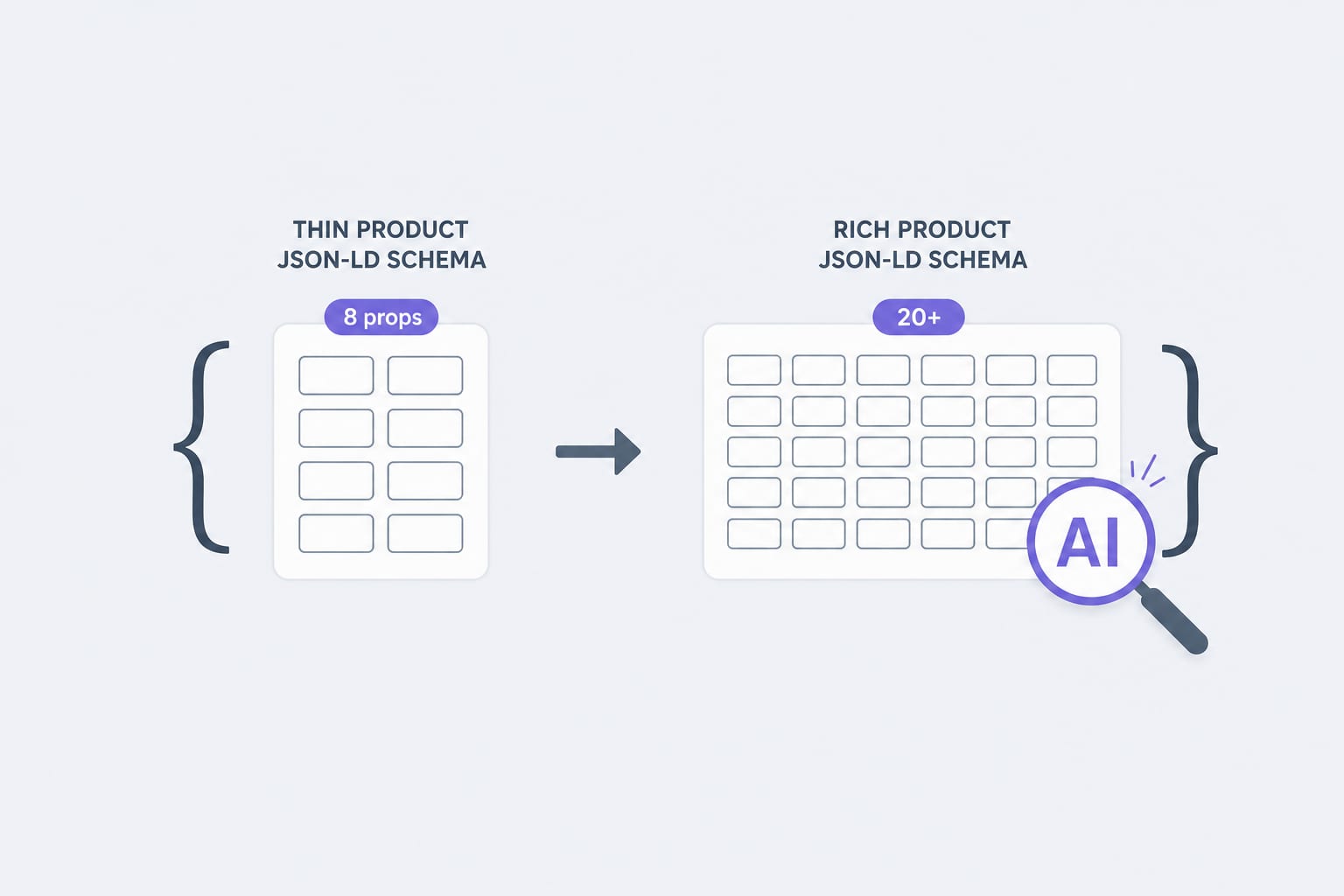

Schema markup pour Shopify en 2026 : les propriétés JSON-LD que les agents IA lisent réellement

Le Product schema traditionnel utilise 8 à 12 propriétés. Les agents IA s'appuient sur 20 ou plus. Voici la liste des propriétés, les règles de validation et le pattern d'implémentation que nous utilisons sur Shopify en 2026.

13 min de lecture

Technical SEOApr 7, 2026

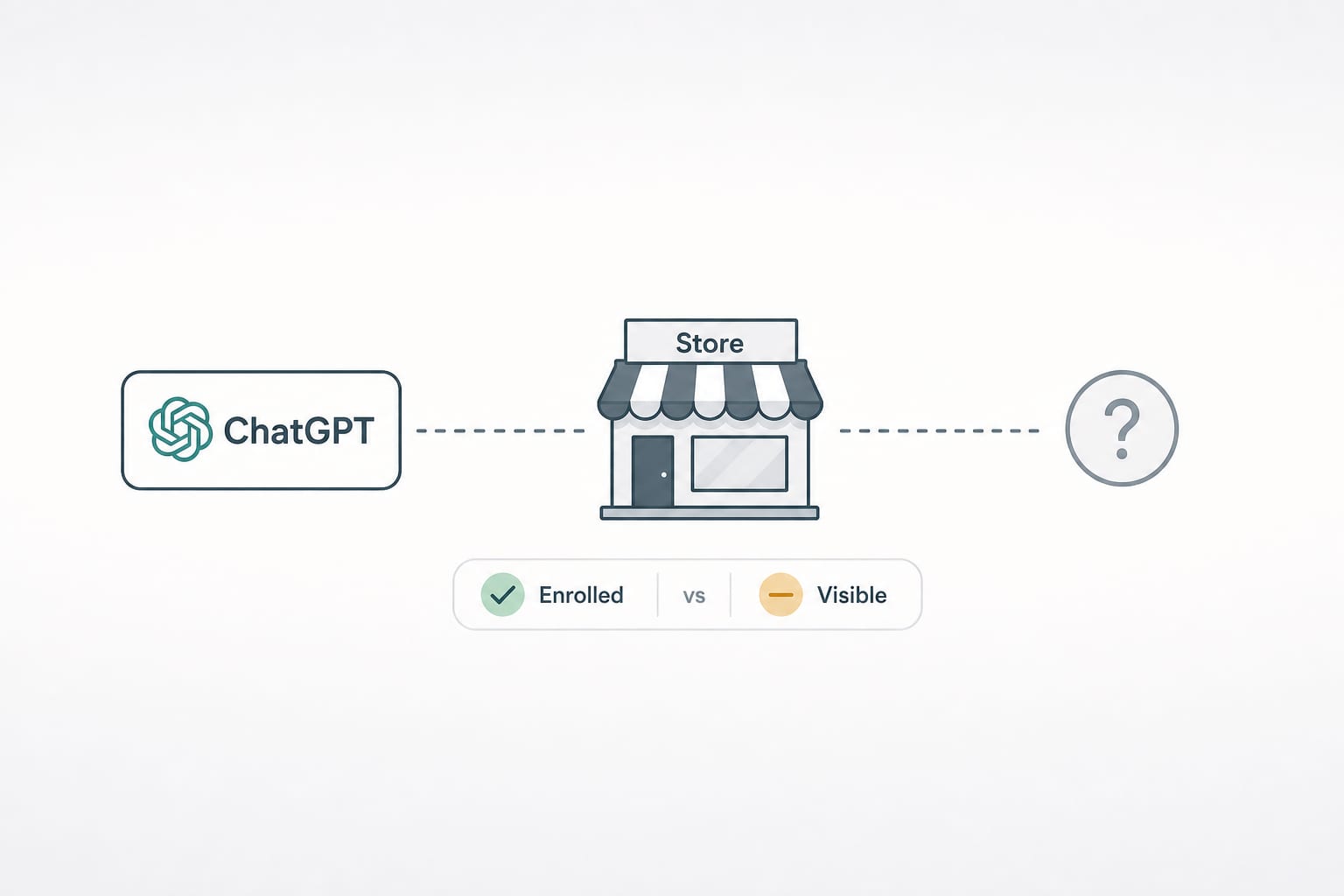

Votre boutique Shopify est-elle visible dans ChatGPT ? L'audit en 10 minutes pour les Agentic Storefronts

Le 24 mars 2026, Shopify a rendu 5,6 millions de boutiques visibles aux agents IA par défaut. Voici l'audit en 10 minutes que nous lançons pour savoir si votre boutique est réellement recommandée, ou simplement inscrite.

14 min de lecture

Technical SEOFeb 17, 2026

Tracking côté serveur pour Shopify : une configuration GTM et GA4 qui survit aux ad blockers et au RGPD

Le guide d'ingénieur pour le tracking côté serveur sur Shopify en 2026. Pourquoi les ad blockers mangent vos données, comment configurer GTM côté serveur sur AWS, le réglage GA4, les contrôles RGPD et le coût réel.

14 min de lecture